Rappels d'algèbre linéaire

Vecteurs et matrices

Vecteurs

Un vecteur

Le produit scalaire entre deux vecteurs

La norme euclidienne est

Deux vecteurs sont orthogonaux si

Matrices

Une matrice

- Transposée :

- Produit matriciel :

- Trace :

(matrices carrées) - Déterminant :

(matrices carrées)

Propriétés du produit :

(associativité) - En général,

(non-commutatif)

Matrices particulières

| Type | Définition | Propriétés |

|---|---|---|

| Symétrique | Valeurs propres réelles | |

| Orthogonale | Préserve les normes | |

| Diagonale | ||

| Identité |

Transformations linéaires

Une matrice

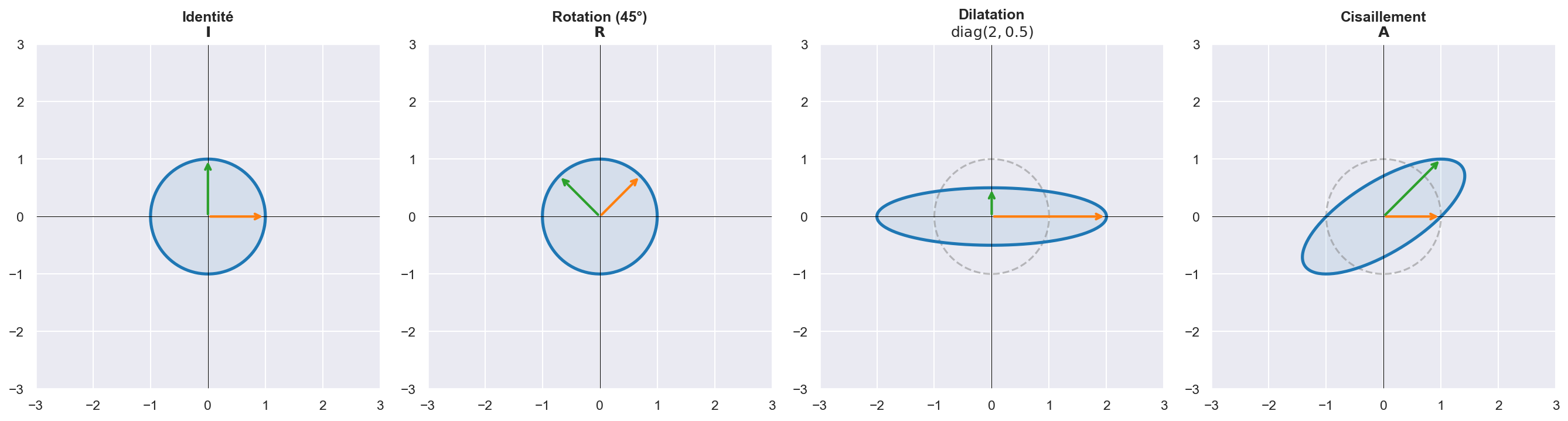

L'image du cercle unité par différentes matrices illustre la nature géométrique des transformations linéaires :

Figure 1 : Image du cercle unité par différentes transformations linéaires

Systèmes linéaires et inverse

Inverse d'une matrice

Une matrice carrée

Propriétés :

Résolution de systèmes linéaires

Le système

- Une solution unique si

est inversible : - Une infinité de solutions si le système est sous-déterminé (

) - Aucune solution exacte si le système est sur-déterminé (

), ce qui conduit à la notion de moindres carrés

Valeurs propres et vecteurs propres

Définition

Un scalaire

Les valeurs propres sont les racines du polynôme caractéristique

Diagonalisation

Si

où

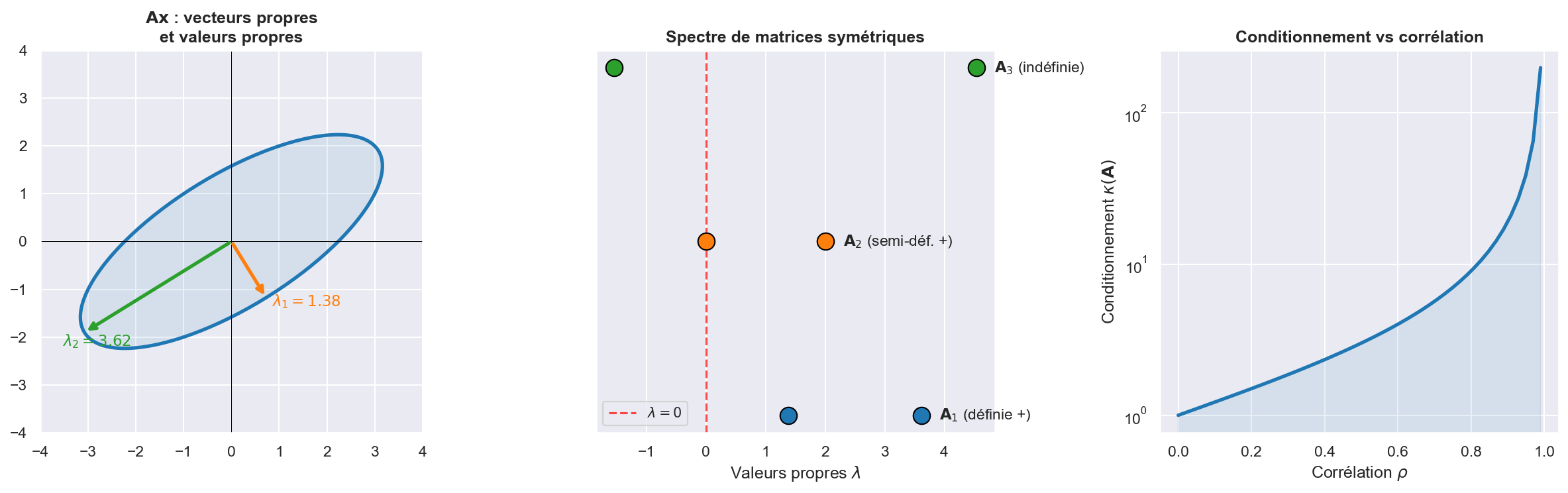

Pour une matrice symétrique

- Toutes les valeurs propres sont réelles

- Les vecteurs propres sont orthogonaux :

avec orthogonale

Figure 2 : Vecteurs propres d'une matrice symétrique, spectre et conditionnement

Conditionnement

Le nombre de conditionnement d'une matrice inversible est :

Un conditionnement élevé (

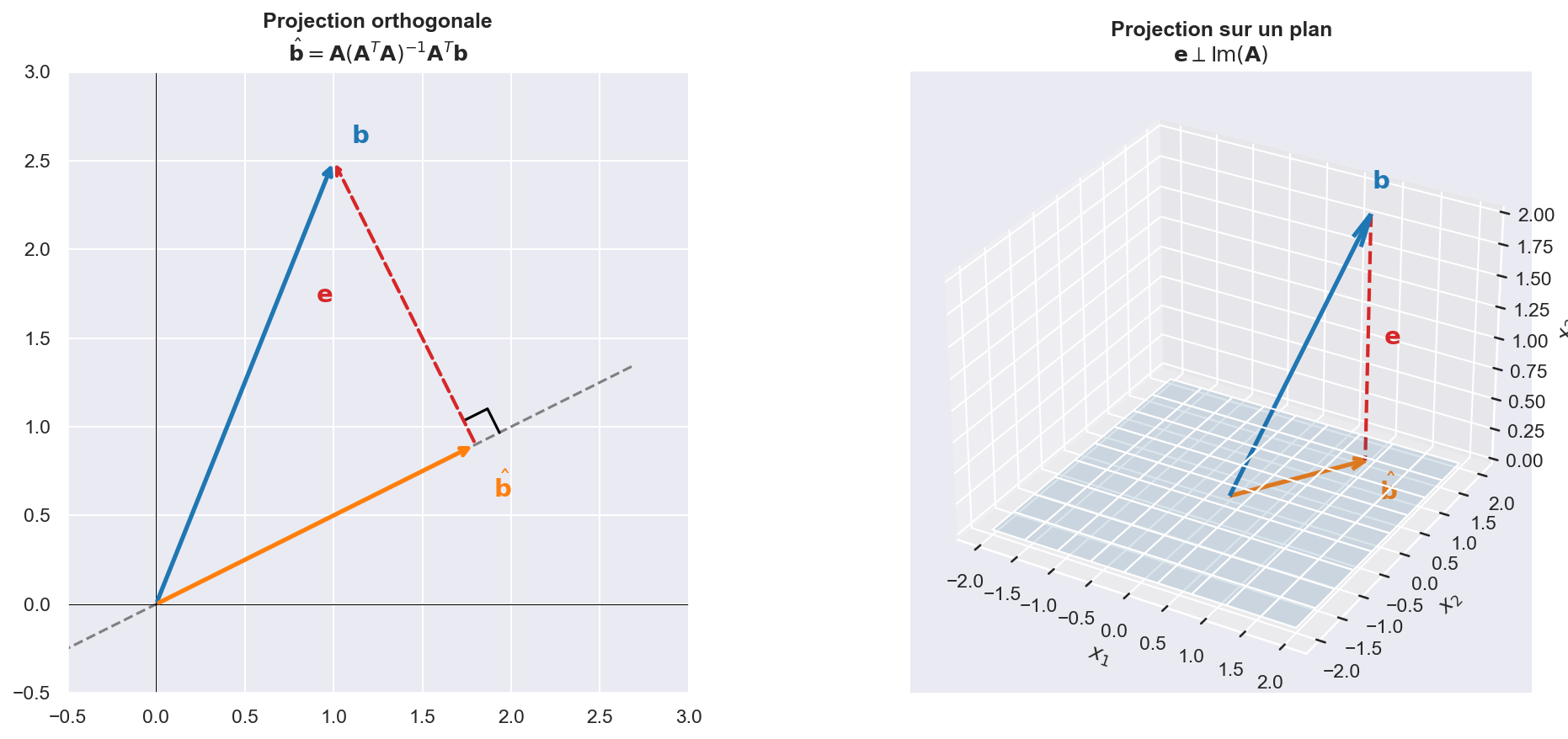

Projection orthogonale

Principe

La projection orthogonale de

La matrice

Propriétés :

(idempotente) (symétrique) - Le résidu

est orthogonal à :

Figure 3 : Projection orthogonale sur une droite (2D) et sur un plan (3D)

Lien avec les moindres carrés

La solution au sens des moindres carrés du système sur-déterminé

C'est exactement le vecteur

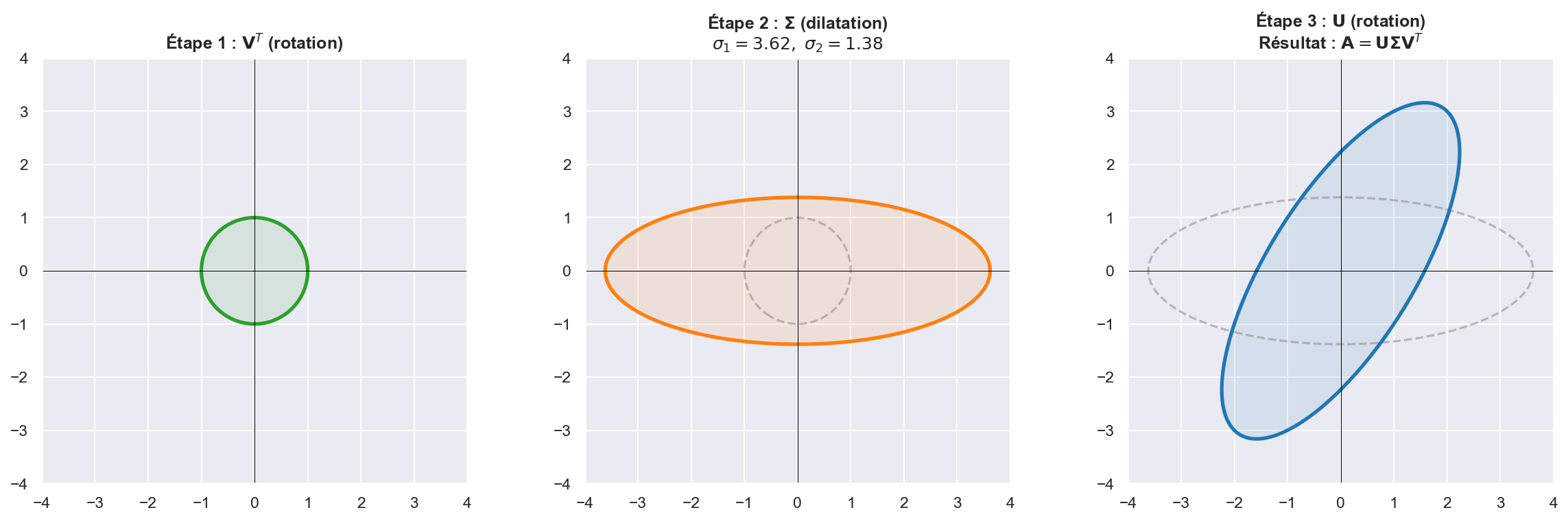

Décomposition en valeurs singulières (SVD)

Définition

Toute matrice

où :

est orthogonale (vecteurs singuliers gauches) est diagonale avec (valeurs singulières) est orthogonale (vecteurs singuliers droits)

Géométriquement, la SVD décompose toute transformation linéaire en trois étapes : rotation, dilatation, rotation.

Figure 4 : Interprétation géométrique de la SVD : rotation → dilatation → rotation

Propriétés

- Le rang de

est le nombre de valeurs singulières non nulles - Les valeurs propres de

sont (norme de Frobenius) - La pseudo-inverse de Moore-Penrose est

Formes quadratiques et matrices définies positives

Forme quadratique

Une forme quadratique associée à une matrice symétrique

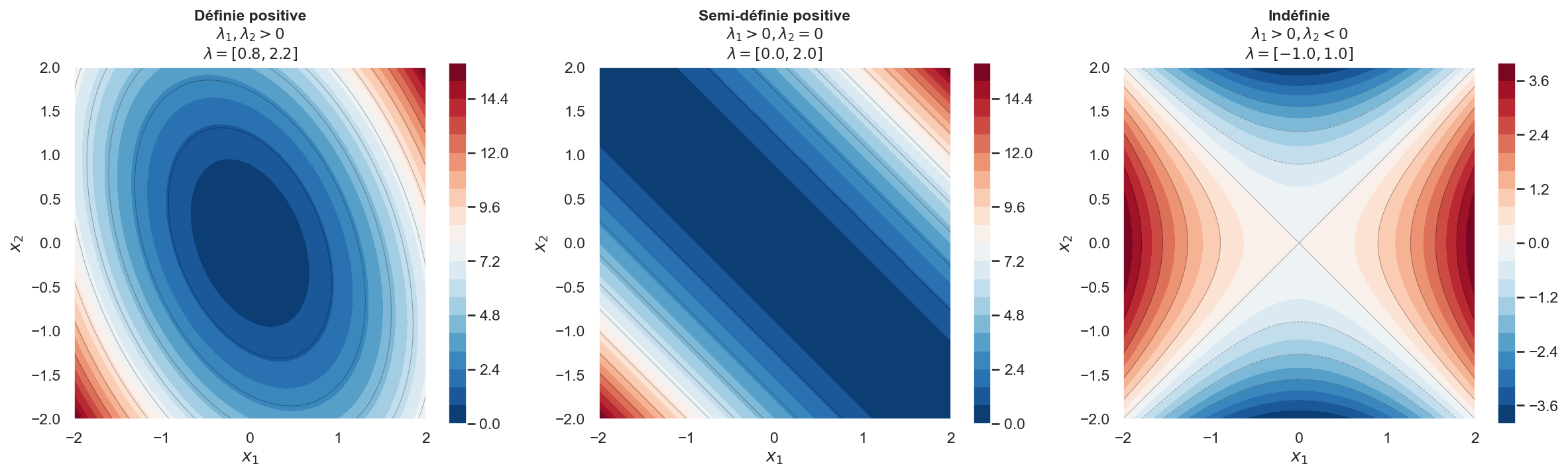

La nature de la forme quadratique dépend du signe des valeurs propres de

| Type | Condition | Valeurs propres |

|---|---|---|

| Définie positive | Toutes | |

| Semi-définie positive | Toutes | |

| Indéfinie | Positives et négatives |

Figure 5 : Lignes de niveau de formes quadratiques selon la nature de la matrice

Matrices définies positives

Les matrices définies positives jouent un rôle central en estimation statistique :

- La matrice de covariance

est semi-définie positive - La matrice

est toujours semi-définie positive est définie positive si et seulement si est de rang plein

Propriétés : Si

est inversible est aussi définie positive - Il existe une unique matrice

définie positive telle que

Dérivation matricielle

Les dérivées matricielles sont essentielles pour l'optimisation en estimation et régression.

Gradient

Le gradient d'une fonction scalaire

Formules utiles

Pour

| Fonction | Gradient |

|---|---|

La dernière formule est directement utilisée pour dériver la solution des moindres carrés : en posant